KI-Agenten.

Programmiert, nicht

zusammengeklickt.

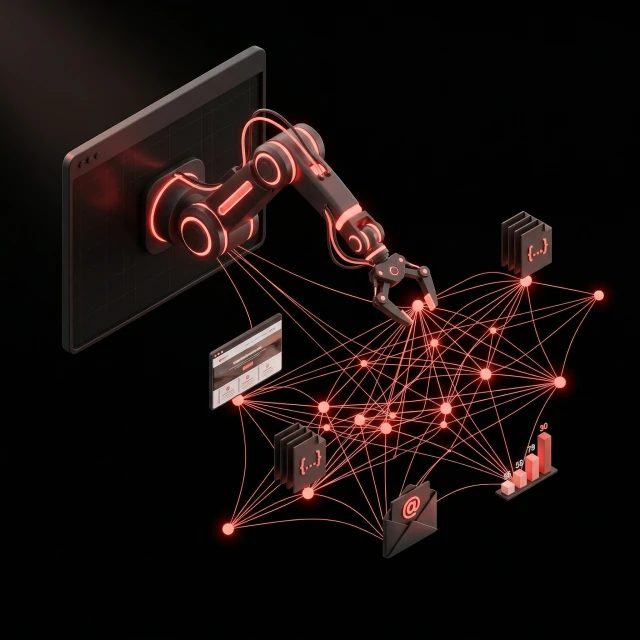

loaded. aus Zürich entwickelt massgeschneiderte KI-Agenten mit Python und Node.js für Schweizer Unternehmen. Keine Low-Code-Plattformen, keine vorgefertigten Module — jeder Agent wird von Grund auf programmiert.

Unsere Agenten recherchieren, analysieren, entscheiden und handeln autonom — rund um die Uhr. Auf Projektbasis, für ausgewählte Kunden in der Schweiz.

KI-Agenten sind keine Chatbots

Ein Chatbot wartet auf Ihre Frage. Ein KI-Agent arbeitet eigenständig. Er recherchiert Daten im Web, analysiert Websites, vergleicht Preise über Monate hinweg, erstellt Berichte, versendet E-Mails — und das rund um die Uhr, ohne manuellen Eingriff. Dabei trifft er Entscheidungen auf Basis der Daten, die er findet: Welcher Prospect ist vielversprechend? Welche Seite braucht eine Content-Anpassung? Welcher Konkurrenzpreis hat sich verändert?

KI-Agent-Plattformen im Vergleich

Der Markt für KI-Agenten wächst schnell. Von visuellen Workflow-Tools bis zu autonomen Agent-Systemen — die Ansätze unterscheiden sich fundamental. Hier eine Einordnung der wichtigsten Plattformen und wo massgeschneiderte Code-Agenten ihren Platz haben.

Schneller Einstieg, hunderte Konnektoren, visuelle Logik. Gut für einfache Automationen mit klar definierten Wenn-Dann-Regeln.

Kein echtes Reasoning, keine dynamische Entscheidungslogik. Keine Sandbox-Ausführung.

Anthropics Agent-Framework: Tool-Use, Computer-Use, Code-Ausführung. Starkes Reasoning.

Gebunden an Claude-Modelle. Managed Agents sind generalistisch. Keine persistente Datenhaltung ohne eigene Infrastruktur.

Lokal, 100+ Skills, LLMs mit Apps und Browser verbunden. 247'000+ GitHub-Stars.

Personal Assistant — nicht für Business-Prozesse. Keine CRM/ERP-Integration. Anfällig für Prompt-Injection.

Führt komplexe Aufgaben autonom aus: Webrecherche, Dokumenterstellung, Datenanalyse.

Blackbox — keine Kontrolle über Logik oder Datenfluss. Keine Business-System-Integration.

Code Interpreter, File Search, Function Calling. Grosses Ökosystem, einfache API.

GPTs haben kein echtes Agency — sie reagieren nur auf Eingaben. Kein Scheduling, keine System-Integration.

Volle Kontrolle über Logik, Prompts, Datenfluss, LLM-Wahl. Multi-Modell. Eigene Sandboxes, eigene Datenbank, eigene API-Integrationen. Keine Plattform-Abhängigkeit.

Höhere initiale Investition. Erfordert erfahrene Entwickler. Nicht für einfache Wenn-Dann-Automationen.

Alle Plattformen haben ihre Berechtigung. n8n und Make.com sind hervorragend für schnelle Prototypen. OpenClaw zeigt eindrucksvoll, was ein lokaler Agent auf dem eigenen Rechner leisten kann. Claude und OpenAI bieten starke Grundlagen für Entwickler. Für Schweizer Unternehmen, die einen Agenten brauchen, der tief in ihre Geschäftssysteme integriert ist, rund um die Uhr zuverlässig arbeitet und sich mit jeder neuen LLM-Generation verbessert — dafür gibt es massgeschneiderten Code.

Was unsere KI-Agenten in der Praxis leisten

6 Einsatzgebiete für Schweizer Unternehmen.

Research & Outreach Agent

Findet automatisch Prospects in einer Branche und Region, analysiert deren Websites technisch — Performance, Tech-Stack, Schwachstellen — und erstellt personalisierte Audit-Seiten. Versendet massgeschneiderte Erstansprachen per E-Mail über Resend mit SPF/DKIM-Authentifizierung. Diesen Agenten setzen wir selbst ein — für die Kundenakquise von loaded. in der Schweiz.

Projekt besprechen →SEO & Content Intelligence

Analysiert Konkurrenz-Seiten live — Wortanzahl, Headings, Schema-Markup, Rankings. Erkennt Content-Gaps automatisch, priorisiert Keywords nach Suchvolumen und Wettbewerb, und schlägt konkrete Anpassungen vor oder nimmt sie direkt vor. Nutzt Google Gemini mit Search-Grounding für Echtzeit-SERP-Analyse. Wir setzen diesen Agenten selbst für loaded.ch ein.

Projekt besprechen →Price Intelligence Agent

Überwacht Konkurrenzpreise automatisch — heute und in drei Monaten. Ideal für Schweizer Hotels, E-Commerce und jede Branche mit dynamischer Preisgestaltung. Crawlt mehrere Quellen parallel, normalisiert Daten in Supabase (Postgres), erstellt zeitbasierte Vergleichsreports mit Trendanalyse. Erkennt Preisänderungen der Konkurrenz, bevor Ihr Revenue-Team sie manuell findet.

Projekt besprechen →Dynamic Page Creation

Erstellt Seiten programmatisch basierend auf Datenbankinhalten, API-Responses oder Nutzereingaben. Volle Kontrolle über Struktur, Schema-Markup, URL-Slug und Meta-Daten — deployed auf Vercel mit SSR oder ISR. Keine CMS-Limitierung, keine Templates. Perfekt für Schweizer KMU mit hunderten Produktseiten oder standortspezifischen Landingpages.

Projekt besprechen →Email Automation

Vollständige E-Mail-Pipelines mit Resend — transaktional und Marketing. Trigger-basiert, API-gesteuert, mit personalisierten Inhalten pro Empfänger. SPF/DKIM-authentifiziert, damit E-Mails im Posteingang landen, nicht im Spam. Kein Mailchimp, kein monatliches Abo — reine API-Logik, unbegrenzt skalierbar.

Projekt besprechen →WebMCP & OpenHermit

Unsere eigene MCP-Implementierung (Model Context Protocol) gibt KI-Agenten direkten Zugriff auf Website-Inhalte, Formulare und APIs. Agenten können nicht nur lesen — sie können handeln: Termine buchen, Anfragen senden, Daten aktualisieren. OpenHermit ist unser Open-Source-Beitrag zum Agent-Ökosystem — entwickelt in Zürich.

Projekt besprechen →In der Praxis: Unser Research & Outreach Agent

Diesen Agenten setzen wir selbst ein. Er findet potenzielle Kunden, analysiert deren Websites automatisch und erstellt personalisierte Audit-Seiten — vollständig ohne manuellen Aufwand. Hier zeigen wir, wie er funktioniert.

Das Ergebnis für den Kunden

Prospect erhält eine E-Mail

Persönlich formuliert, basierend auf der echten Analyse seiner Website. Kein Template, kein Massenversand — jede E-Mail ist individuell.

Klickt auf seinen persönlichen Audit-Link

Eine eigens generierte Seite zeigt: Screenshot seiner Website, Performance-Score, technische Schwachstellen, Vergleich mit zwei Konkurrenten aus der gleichen Stadt.

Kann direkt eine Anfrage stellen

Ein CTA-Formular auf der Audit-Seite. Anfrage wird in Echtzeit gespeichert, der Prospect erhält eine Bestätigung, wir werden sofort benachrichtigt.

Was der Agent im Hintergrund macht

Scout: Prospects finden

Gemini mit Google-Search-Grounding sucht nach Unternehmen einer bestimmten Branche und Region. Für jede gefundene Website wird ein Tech-Debt-Score berechnet: WordPress, jQuery 1.x, Bootstrap 3, IE-Polyfills — je höher der Score, desto grösser der Handlungsbedarf.

Analyse: Performance messen + KI-Vision

Zwei parallele Google PageSpeed Insights Calls (Mobile + Desktop). Der Desktop-Screenshot geht an Gemini Vision — das Modell sieht die Website und erstellt eine strukturierte Analyse: Schwachstellen, Potenzial, eine massgeschneiderte Erstansprache.

Outreach: Kontakt finden + E-Mail versenden

Vier-Schicht-Kontaktsuche: mailto-Links, Regex im HTML, Obfuscation-Decoder, Crawl von /kontakt, /impressum, /about — und als letztes Mittel eine Gemini-Websuche. Die Audit-Daten werden via API gespeichert, eine SSR-Seite wird live gerendert, die E-Mail wird mit Resend versendet.

Steuert den gesamten Prozess: Scout → Analyse → Outreach. Kommuniziert mit Gemini, Google PSI und der Website-API.

Empfängt Audit-Daten via API, rendert personalisierte Audit-Seiten per SSR. Trackt Views und Anfragen in Echtzeit.

Postgres mit Row Level Security. Speichert alle Audit-Daten als JSONB: Analyse, PSI-Scores, Screenshots, Konkurrenzvergleich.

Der vollständige Datenfluss

Technisches Blueprint — Pipeline im Detail

Scout — Prospects finden

scout.jsGemini mit Google-Search-Grounding sucht nach Unternehmen einer bestimmten Branche und Region. Für jede gefundene Website wird ein Tech-Debt-Score berechnet.

const prompt = `Finde 10 ${branche} in ${city}

mit eigener Website. Gib URLs zurück.`;

const results = await gemini.generate({

model: 'gemini-2.0-flash',

tools: [{ googleSearch: {} }],

prompt

});

// Tech-Debt-Score berechnen

for (const url of results.urls) {

const html = await fetchHTML(url);

const score = calcTechDebt(html);

// WordPress=3, jQuery 1.x=2, Bootstrap 3=2

}Fetch + PageSpeed Insights

outreach.jsParallele Requests: HTML-Fetch mit Redirect-Handling (5 Hops), Self-Signed-Cert-Bypass. Zwei PSI-Calls (Mobile + Desktop) via Promise.allSettled.

const [mobile, desktop] = await Promise.allSettled([

psiCall(url, 'MOBILE'),

psiCall(url, 'DESKTOP')

]);

const screenshot = desktop.value

?.lighthouseResult?.audits

?.['final-screenshot']

?.details?.data; // base64 JPEG

const perfScore = mobile.value

?.lighthouseResult?.categories

?.performance?.score * 100;Kontakt-Email finden

outreach.js — findEmailVier-Schicht-Suche: mailto-Links → Regex im HTML → Obfuscation-Decoder (info[at]domain.ch) → Crawl von /kontakt, /impressum, /about → als Fallback: Gemini-Websuche.

async function findEmail(html, domain) {

// Layer 1: mailto links

let email = html.match(/mailto:([^"]+)/)?.[1];

if (email) return email;

// Layer 2: regex in raw HTML

email = html.match(/[\w.-]+@[\w.-]+\.\w+/)?.[0];

if (email) return email;

// Layer 3: obfuscation decoder

email = decodeObfuscated(html);

// info[at]domain.ch → info@domain.ch

// Layer 4: crawl subpages

for (const p of ['/kontakt','/impressum'])

email ??= await scrape(domain + p);

}Gemini Vision Analysis

outreach.js — deepAnalyzeScreenshot (base64 JPEG) + Tech-Signale als Multimodal-Request an Gemini 2.0 Flash. Rückgabe als strukturiertes JSON: Business-Typ, Schwachstellen, Potenzial, personalisierter E-Mail-Betreff und Intro.

const analysis = await gemini.generate({

model: 'gemini-2.0-flash',

contents: [{

parts: [

{ inlineData: { mimeType: 'image/jpeg',

data: screenshot } },

{ text: `Analysiere diese Website.

Rückgabe als JSON:

{ businessType, weaknesses[],

potential, emailSubject,

emailIntro }` }

]

}]

});

// Post-processing

analysis.emailIntro = analysis.emailIntro

.replace(/cookie|banner/gi, '')

.split('.').slice(0, 3).join('.');Konkurrenz-Benchmark

outreach.js — getCompetitorsPSIGemini schlägt zwei Konkurrenten aus der gleichen Stadt vor. HEAD-Request zur URL-Validierung, dann parallele PSI-Calls. Ergebnis: Vergleichsbalken auf der Audit-Seite.

const competitors = await gemini.generate({

prompt: `Nenne 2 Konkurrenten für

${businessType} in ${city}`

});

// Validate URLs exist

const valid = await Promise.all(

competitors.map(async (c) => {

const res = await fetch(c.url, {method:'HEAD'});

return res.ok ? c : null;

})

);

// Parallel PSI for each competitor

const scores = await Promise.allSettled(

valid.filter(Boolean).map(c => psiCall(c.url))

);Speichern + Audit-Seite generieren

outreach.js — saveToAPIPOST an die Website-API mit Bearer-Token-Auth. Upsert in Supabase (view_count und redesign_requested bleiben bei Re-Runs erhalten). Die Audit-Seite wird per SSR gerendert.

await fetch('https://loaded.ch/api/audit/save', {

method: 'POST',

headers: {

'Authorization': `Bearer ${AUDIT_SECRET}`,

'Content-Type': 'application/json'

},

body: JSON.stringify({

slug, url, perfScore, analysis,

screenshot, competitors, email

})

});

// Supabase upsert (preserves view_count)

// SSR page: loaded.ch/audit/[slug]

// view_count++ on each visitE-Mail versenden

outreach.js — sendEmailResend API mit SPF/DKIM-Authentifizierung. Bewusst schlichtes HTML — sieht aus wie eine echte Gmail-Nachricht, kein Marketing-Template. HTML- und Text-Version für maximale Zustellbarkeit.

import { Resend } from 'resend';

const resend = new Resend(RESEND_API_KEY);

await resend.emails.send({

from: 'Benjamin <hello@loaded.ch>',

to: contactEmail,

subject: analysis.emailSubject,

html: buildGmailStyleHTML({

intro: analysis.emailIntro,

auditUrl: `https://loaded.ch/audit/${slug}`,

perfScore,

businessName

}),

text: buildPlainText({ /* ... */ })

});Output — Audit-Daten in Supabase

{

"slug": "restaurant-bellevue-zuerich",

"url": "https://restaurant-bellevue.ch",

"perf_mobile": 34,

"perf_desktop": 61,

"tech_debt_score": 7,

"analysis": {

"businessType": "Restaurant",

"weaknesses": [

{ "issue": "Render-blocking CSS", "severity": "high" },

{ "issue": "No image optimization", "severity": "high" },

{ "issue": "jQuery 1.12.4", "severity": "medium" }

]

},

"competitors": [

{ "name": "Kronenhalle", "score": 72 },

{ "name": "Zeughauskeller", "score": 58 }

],

"view_count": 0,

"redesign_requested": false

}Unser Tech-Stack für KI-Agenten

Die Tools und Frameworks hinter unseren Agenten.

Python · Node.js / TypeScript — je nach Use Case. Python für Datenverarbeitung und ML-Integration. Node.js für Web-Scraping, API-Kommunikation und Echtzeit-Systeme.

Anthropic Claude · OpenAI · Google Gemini · LangChain · LangGraph — wir wählen das Modell nach Aufgabe: Vision, Reasoning, Speed, Kosten.

Supabase (Postgres) · Vercel · Docker · Daytona Sandbox-Umgebungen für sichere Code-Ausführung. Schweizer Hosting möglich für nDSG-konforme Projekte.

Resend (E-Mail) · WebMCP / OpenHermit (Agent-Website-Interaktion) · Jede REST- oder GraphQL-API · Webhooks · CRM · ERP · Datenbank-Direktzugriff.

Sandboxes: Warum Sicherheit bei KI-Agenten Grundvoraussetzung ist

KI-Agenten führen Code aus, sprechen APIs an und verarbeiten Daten — dafür brauchen sie kontrollierte Umgebungen. Wir nutzen Daytona Sandboxes: isolierte Environments, in denen jeder Agent-Prozess nur Zugriff auf die Ressourcen hat, die er braucht. Kein unkontrollierter Zugriff auf Produktionssysteme, keine offenen Netzwerkverbindungen. Für Schweizer Unternehmen mit nDSG-Anforderungen kann die gesamte Infrastruktur auf Schweizer Servern betrieben werden.

So entsteht Ihr KI-Agent

Discovery

Welcher Prozess soll automatisiert werden? Welche Datenquellen existieren? Welche Systeme müssen angebunden werden? Wir definieren den Scope gemeinsam — und prüfen, ob ein Agent die richtige Lösung ist.

Architektur

Welches LLM für welche Aufgabe? Welche Pipeline-Schritte? Wie sieht die Fehlerbehandlung aus? Wir entwerfen die Agent-Architektur, bevor eine Zeile Code geschrieben wird.

Build & Test

Iterative Entwicklung mit echten Daten. Prototyp nach 1–2 Wochen, Produktionsversion nach 4–8 Wochen. Prompt-Engineering, Edge-Case-Handling, Performance-Optimierung — bis der Agent zuverlässig liefert.

Betrieb & Evolution

Ein Agent wird nicht einmal gebaut und vergessen. Neue LLM-Modelle bringen besseres Reasoning, niedrigere Kosten, neue Fähigkeiten — fast wöchentlich. Wir testen, optimieren und erweitern kontinuierlich.

Auf Projektbasis — für ausgewählte Kunden

KI-Agenten erfordern intensive Zusammenarbeit und laufende Betreuung. Wir arbeiten gezielt mit wenigen Kunden, um maximale Qualität zu garantieren.

Projekt besprechen →Häufig gestellte Fragen

Was genau ist ein KI-Agent?

Warum programmiert loaded. Agenten von Grund auf?

Für welche Branchen eignen sich KI-Agenten?

Wie lange dauert die Entwicklung eines KI-Agenten?

Was kostet ein KI-Agent?

Warum arbeitet loaded. nur mit ausgewählten Kunden?

Wie wird mein Agent gehostet und betrieben?

Was passiert nach dem Launch?

Kann ein Agent mit meinen bestehenden Systemen kommunizieren?

Wie sicher sind die Agenten?

Kostenloses Strategiegespräch buchen.

30 Minuten — unverbindlich, kein Verkaufsgespräch. Wir analysieren Ihre Situation und zeigen, was möglich ist.

Verfügbare Zeiten konnten nicht geladen werden. Bitte kontaktieren Sie uns per E-Mail.

hello@loaded.ch